Nicola Binetti

(30Science.com) – Roma, 2 nov. – “Ogni individuo possiede una rappresentazione unica su come vengano espresse differenti emozioni, affine all’idea di un’impronta digitale”. Lo ha spiegato a 30Science.com, Nicola Binetti, ricercatore della Scuola Internazionale Superiore di Studi Avanzati di Trieste (SISSA) che è appena rientrato in Italia dopo aver guidato un gruppo di lavoro alla Queen Mary University of London insieme al quale ha mappato diverse espressioni facciali umane grazie alla combinazione di algoritmi genetici con avatar 3D fotorealistici. La gamma di espressioni facciali umane associate a un particolare stato emotivo non è ancora nota, in parte perché il numero di possibili espressioni è molto vasto. Ciascuno dei 336 partecipanti allo studio, i cui risultati sono stati pubblicati su PNAS, ha creato l’espressione corrispondente a una particolare emozione e un algoritmo ha permesso ai partecipanti di far evolvere i volti per raggiungere la loro espressione preferita in più prove.

Quali sono i principali risultati che sono emersi dai vostri esperimenti?

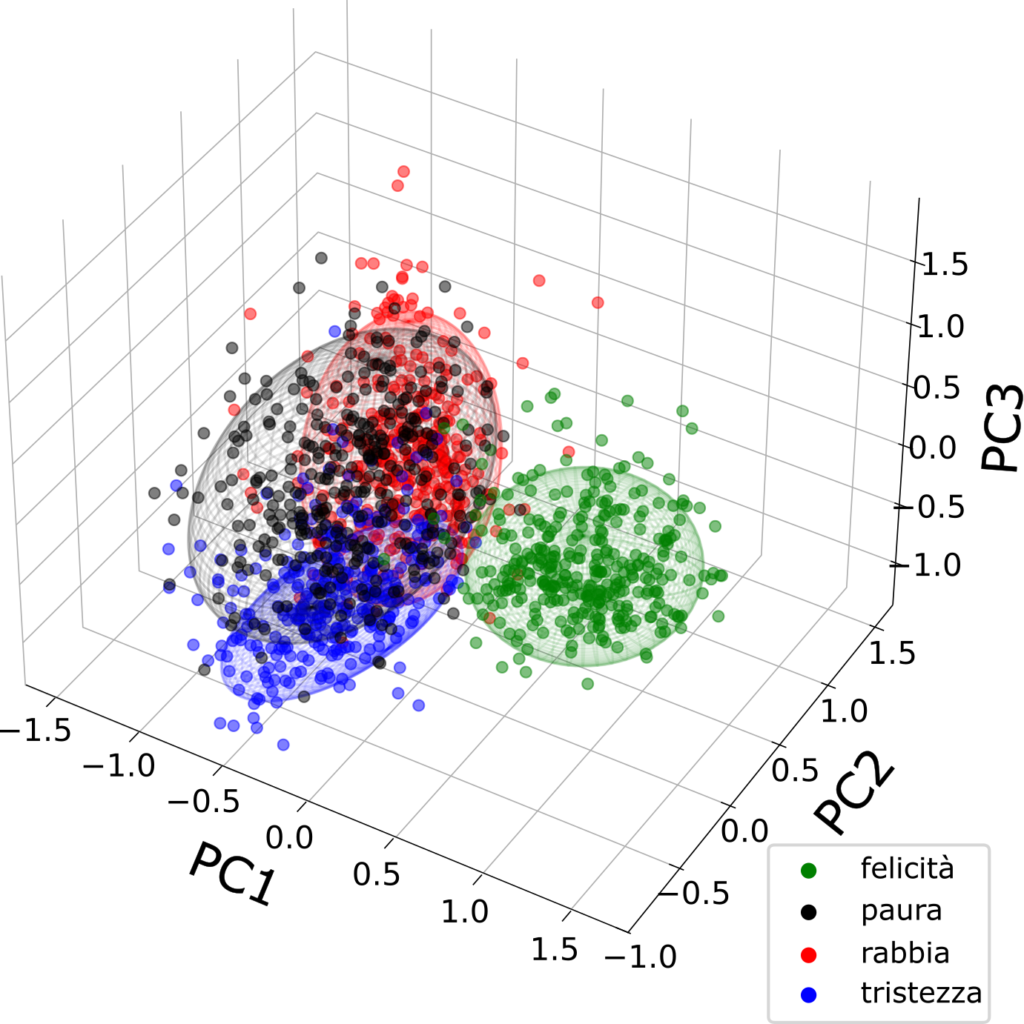

Grafico che rappresenta la distribuzione (ossia come si raggruppano e quanto si differenziano) le espressioni create da tutti i partecipanti

Ci può descrivere il metodo che avete utilizzato?

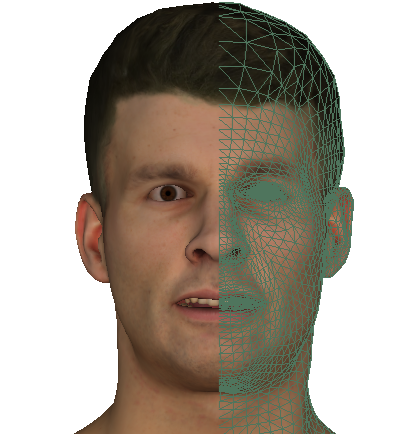

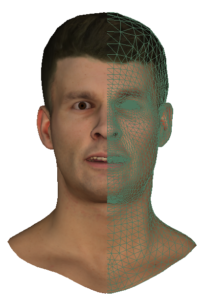

Abbiamo utilizzato una tecnica fondata su algoritmi genetici per consentire a persone di modellare espressioni facciali raffigurate da un volto artificiale (3D), che rappresentano stati di felicità, tristezza, rabbia o paura. Algoritmi genetici sono ispirati a meccanismi di selezione naturale, dove vengono selezionati ed evoluti tratti presenti in una popolazione. Possiamo prendere ad esempio l’allevamento di cani, dove a partire da una serie di esemplari, possiamo enfatizzare o rimuovere alcuni tratti presenti nel gruppo selezionando quali animali possono riprodursi. Un criterio simile e’ stato adottato con i volti artificiali presentati ai nostri partecipanti. A partire da una serie di 10 volti raffiguranti diverse espressioni, i partecipanti selezionano quali volti hanno una mimica compatibile con l’espressione che intendono modellare (ad es un volto che esprime rabbia). Queste selezioni determinano quali tratti espressivi saranno incrociati e quali “geni” verranno propagati alla generazione futura (una nuova serie di 10 volti generati dall’algoritmo). Questo processo si ripete più volte, dove nell’ultima generazione le espressioni convergono sulla rappresentazione che quel partecipante ha di un particolare stato affettivo. (Nella gallery sopra esempi di espressioni create da alcuni partecipanti 3 per emozione e-immagini (“heatmaps“) che mostrano quali parti del volto variano maggiormente tra espressioni create da tutti i partecipanti, 1 per ogni emozione)

render di un volto con wireframe